서 론

연구 방법

문헌조사 방법

UAV 플랫폼 및 센서 개요

AI 탐지 기법 개요

UAV-AI 기반 자동 외관 검사 기술의 주요 사례 분석

강재 교량 부식 탐지 사례

철제 송전탑 부식 탐지 사례

철제 송전탑 외관 손상 탐지 사례

통신탑 부식 탐지 사례

콘크리트 교량 손상 탐지 사례

항만 크레인 실시간 손상 탐지 사례

항만 크레인 구조 건전성 정밀 모니터링 사례

UAV-AI 기반 외관 검사 기술의 구성 요소, 한계 및 확장 가능성 분석

UAV 플랫폼과 센서 구성의 비교

AI 기법의 선택과 기술적 특성

UAV-AI 기반 외관 검사 기술의 공통적 한계

고위험 건설기계로의 기술 확장 가능성

결 론

서 론

최근 무인항공기(UAV, Unmanned Aerial Vehicle)는 다양한 산업 현장에서 사람이 접근하기 어렵거나 위험한 지점을 점검하는 수단으로 활발히 활용되고 있다. The Business Research Company(2025)의 보고서에 따르면, 드론 기반 점검·모니터링 시장은 2024년 약 134억 달러에서 2029년 316억 달러로 성장하여 연평균 19.4%의 성장률을 기록할 것으로 전망된다. 이러한 성장세는 센서와 배터리 성능 향상에 따른 비용 절감, 데이터 정밀도 개선, 운용 안전성 강화 등 기술 발전과 맞물려 UAV의 활용 범위를 더욱 확대시키고 있다.

UAV가 위험 지역의 안전 점검 및 모니터링 수단으로 자리 잡으면서 다양한 연구가 수행되었다. 초기 UAV 기반 점검 기술은 주로 RGB 영상 및 LiDAR 데이터를 활용한 전통적 영상처리 기법에 의존하였으며, 색상 변환, 이진화, 필터링 등을 통해 균열, 부식, 오염을 식별하는 방식이 적용되었다(Kim et al., 2015; Yeum and Dyke, 2015; Ribeiro et al., 2020). 예를 들어, Ly and Phung(2020)은 경전철 구조물의 UAV 촬영 영상을 Grayscale 변환 및 이진화를 통해 균열을 검출하였고, Sikora et al.(2023)은 풍력터빈 블레이드의 표면 결함을 RGB 이미지와 LiDAR 데이터의 융합 분석으로 식별하였다. 또한 Marchewka et al. (2020)은 고해상도 RGB 이미지를 HSV(Hue, Saturation, Value) 색공간으로 변환한 뒤 색상 임계값 기반 분할과 필터링을 적용하여 강교의 금속 부식을 자동으로 검출하였다. 그러나 이러한 전통 기법은 조명 변화에 민감하고 결함 유형 구분이 어렵다는 한계를 가지며, 대규모 데이터의 실시간 분석에도 적합하지 않다.

이러한 한계는 인공지능(Artificial Intelligence, AI)의 발전과 맞물려 UAV 기반 점검 연구를 AI 중심의 자동 외관 검사 분야로 빠르게 전환시키는 계기가 되었다. 머신러닝 기법(K-NN, Random Forest, Naive Bayes 등)에서부터 딥러닝 기반 모델(Convolutional Neural Network, CNN; ResNet; U-Net; You Only Look Once, YOLO 등)에 이르기까지 다양한 알고리즘이 적용되면서, 균열·부식·구조 변형 등 인프라 구조물의 손상을 자동으로 탐지할 수 있게 되었다. 실제로 송전탑(Bao et al., 2022; Panigrahy and Karmakar, 2024), 강교(Raja et al., 2021), 콘크리트 교량(Lin et al., 2021; Paik et al., 2021), 댐 등 토목·에너지 기반 인프라를 대상으로 UAV–AI 기반 자동 외관 검사 연구가 활발히 진행되고 있다(Wang et al., 2022; Nooralishahi et al., 2022). 그러나 고위험 건설기계를 대상으로 한 연구는 여전히 제한적이다. 항만 크레인(Chen et al., 2019), 컨테이너 크레인(De Arriba López et al., 2024) 등 일부 사례(Wang et al., 2020; Zhou et al., 2024)가 보고되었으나, 타워크레인이나 항타기와 같은 주요 건설기계로의 본격적 확장은 이루어지지 않았다. 특히 건설기계는 반복적 고위험 작업이 수반되며, 구조 증설과 같은 구조 변경 과정에서 주기적 점검이 필수적이기에 UAV–AI 기반 점검의 적용이 효과적이다.

이와 같은 연구 흐름 속에서 UAV 기반 구조물 점검 및 모니터링 기술을 다룬 기존 리뷰 논문들도 다수 발표되었다. 대표적으로 열화상 기반 구조물 건전성 모니터링(Ma et al., 2025), 풍력터빈 블레이드 점검(Heo and Na, 2025), 철도 인프라 모니터링(Aela et al., 2024), 교량 상태 평가(Feroz and Abu Dabous, 2021; Panigati et al., 2025), 건설 산업 전반에서의 UAV 활용(Mahajan, 2021) 등이 있다. 그러나 기존 리뷰 논문들은 대부분 교량, 풍력터빈, 철도 등 토목·에너지 기반 인프라에 집중되어 있으며, 고위험 건설기계를 대상으로 UAV–AI 기반 자동 외관 검사 기술을 종합적으로 분석한 체계적 연구는 아직 보고되지 않았다.

이에 본 논문은 고위험 건설기계 분야에서 UAV–AI 기반 자동 외관 검사 기술의 적용 가능성을 모색하기 위한 기초적 토대를 마련하고자 한다. 이를 위해 교량, 송전탑, 통신탑 등과 같이 대형 구조물의 특성상 수동 점검이 어렵다는 점에서 고위험 건설기계와 유사한 사례를 포함하고, 컨테이너 크레인 관련 연구까지 총 7편의 논문을 선별하여 상세히 분석하였다. 분석 대상 연구는 적용 구조물의 특성, 센서 구성, 탐지 기법 등을 기준으로 분류·정리하고 상호 비교하였다. 이를 통해 UAV–AI 기반 자동 외관 검사 기술의 현황을 체계적으로 고찰하고, 향후 타워크레인, 항타기 등 고위험 대형 건설기계에의 적용 가능성을 논의한다.

연구 방법

문헌조사 방법

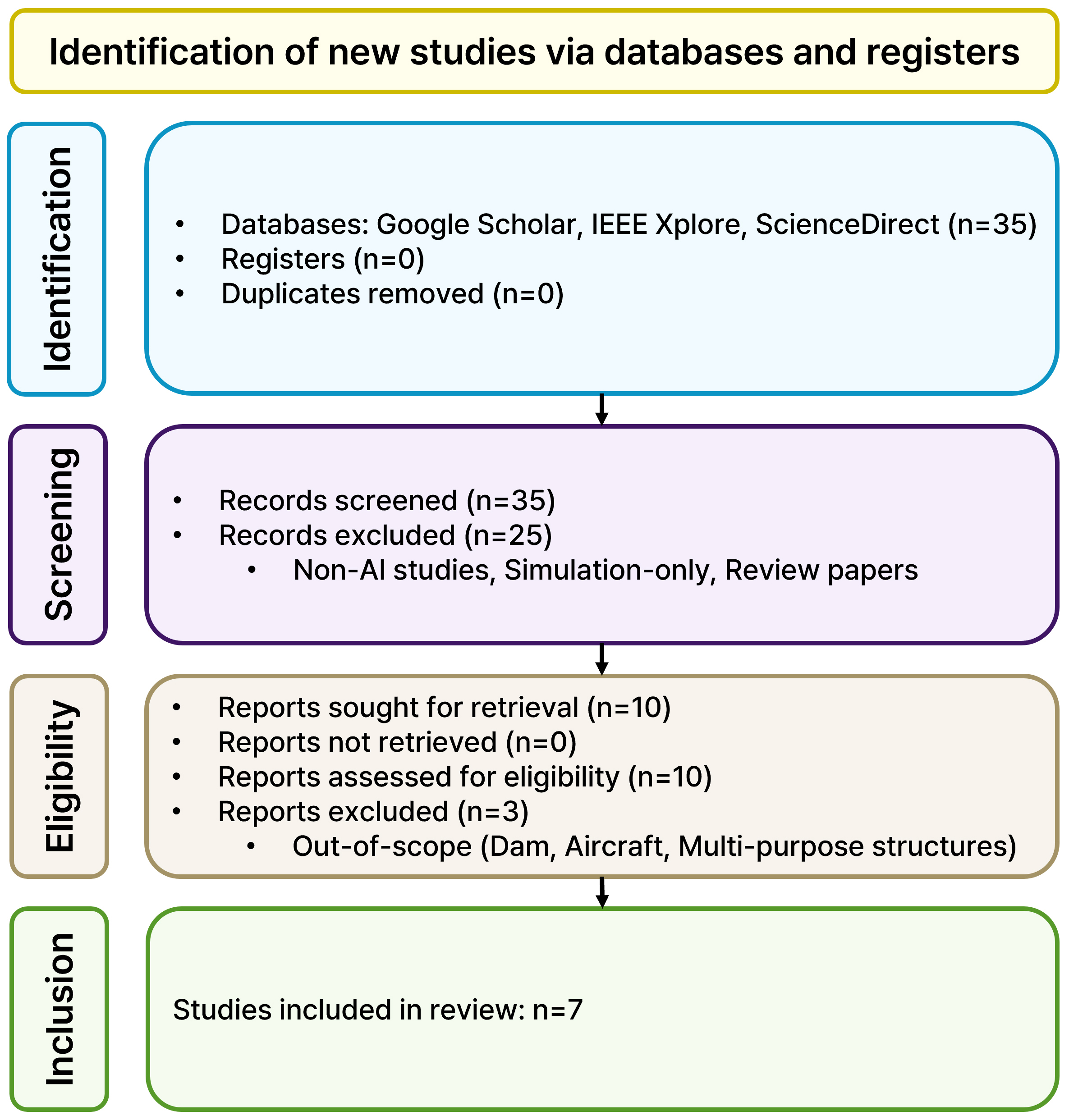

본 연구에서는 2014년부터 2025년까지 발표된 UAV 기반 구조물 외관 점검 및 손상 탐지 관련 논문을 대상으로 문헌조사를 수행하였다. 검색은 Google Scholar, IEEE Xplore, ScienceDirect 등 주요 학술 데이터베이스를 활용하였으며, “UAV”, “drone”, “detection”, “defect”, “corrosion”, “crack” 등을 핵심 키워드로 사용하였다. 초기 검색을 통해 총 35편의 논문을 확보하였으며, 이 중 AI 기법을 포함하지 않는 연구, 실제 현장 적용성 검증이 부족한 단순 시뮬레이션 기반 연구, 리뷰 논문 등은 제외하였다. 논문 검색 및 선별 과정은 Fig. 1에 도식화하였다.

또한 연구 범위와의 일치성을 고려하여 교량, 송전탑, 크레인, 철근콘크리트 구조물 등 대규모 인프라를 대상으로 한 연구만을 선정하였다. 최종적으로 7편의 논문을 선별하였으며(Table 1), UAV 플랫폼 유형과 센서 특성, 적용된 AI 기법 및 성능 평가지표를 정리하여 기술적 배경과 분류 체계를 마련하였다.

Table 1.

Selected UAV-based structural inspection and defect detection studies

| Author | Year | Title |

Journal (Proceedings) | Country of Affiliation of Authors |

| Chen et al. | 2019 | Corrosion detection for large steel structure base on UAV integrated with image processing system | IOP Conf. Ser.: Materials Science and Engineering | China |

| Barreiro et al. | 2021 | Automated damage inspection of power transmission towers from UAV images | Proc. VISAPP 2022 | Germany |

| Forkan et al. | 2022 | CorrDetector: A framework for structural corrosion detection from drone images using ensemble deep learning | Expert Systems with Applications | Australia, UK, India |

| Liang et al. | 2023 | UAV-based low altitude remote sensing for concrete bridge multi-category damage automatic detection system | Drones | South Korea |

| Ameli et al. | 2023 | Deep learning-based steel bridge corrosion segmentation and condition rating using Mask R-CNN and YOLOv8 | Infrastructures | Iran, USA |

| De Arriba López et al. | 2024 | Automatic non-destructive UAV-based structural health monitoring of steel container cranes | Applied Geomatics | Germany |

| Savino et al. | 2025 | Automated corrosion surface quantification in steel transmission towers using UAV photogrammetry and deep convolutional neural networks | Computer‐Aided Civil and Infrastructure Engineering | Italy |

UAV 플랫폼 및 센서 개요

UAV 기반 점검 연구에서 플랫폼의 형태와 센서의 구성은 운영 효율성과 탐지 성능에 직접적인 영향을 미친다. 본 연구에서 분석한 사례에 적용된 UAV 플랫폼은 크게 고정익, 회전익(multirotor), 하이브리드로 구분되며, 각 유형은 장단점과 적용 분야에서 뚜렷한 차이를 보인다(Table 2). 고정익 UAV는 장거리·장시간 비행이 가능해 대규모 지역 탐사에 적합하지만 근접 촬영에는 한계가 있다. 반면, 회전익 UAV는 정지 비행과 수직 이착륙이 가능해 교량, 크레인 등 복잡한 구조물 점검에 주로 활용된다. 하이브리드 UAV는 두 장점을 결합해 장거리 비행과 근접 점검을 모두 수행할 수 있으나, 구조가 복잡하고 비용이 높다는 제약이 따른다.

Table 2.

Key characteristics and applications of UAV platforms

센서는 Table 3과 같이 주로 광학(RGB) 카메라, 열화상(IR, Infrared Ray) 센서, LiDAR가 사용된다. RGB 카메라는 고해상도 영상을 제공하여 균열 및 부식과 같은 외관 결함 탐지에 적합하다. IR 센서는 표면 온도 분포를 기반으로 내부 결함(예: 누수, 박리) 탐지에 활용되며, LiDAR는 구조물의 3차원 형상 재현에 강점을 지녀 구조 변형이나 안전성 평가에 유용하다. 본 연구는 이러한 센서 특성을 고려하여 분석 대상 논문에서의 활용 방식을 비교·정리하였다.

Table 3.

Characteristics of key sensors for UAV-based visual inspection

AI 탐지 기법 개요

UAV 기반 구조물 점검 연구에서 인공지능(AI) 기법은 탐지 대상, 데이터 특성, 연구 목적에 따라 크게 Detection, Segmentation, Classification의 세 가지 범주로 구분된다.

• Detection은 객체의 위치와 크기를 바운딩 박스 형태로 탐지하는 방식으로, 대표적으로 Faster R-CNN(Ren et al., 2015)과 YOLO(Redmon et al., 2016) 계열 모델이 활용된다.

• Segmentation은 객체를 픽셀 단위로 분할하여 정밀한 경계를 제공하는 기법으로, Semantic segmentation(픽셀 단위 클래스 구분)과 Instance segmentation(개별 객체 구분)으로 나뉜다. 대표적인 모델로는 U-Net(Ronneberger et al., 2015), Mask R-CNN(He et al., 2017), DeepLab(Chen et al., 2017)이 있다.

• Classification은 데이터나 객체를 사전에 정의된 클래스에 따라 유형별로 분류하는 기법으로, 전통적 머신러닝 기법뿐 아니라 Visual Geometry Group(VGG; Simonyan and Zisserman, 2014), ResNet(He et al., 2016)과 같은 딥러닝 모델, 최근의 Transformer 기반 모델까지 폭넓게 적용되고 있다.

이들 기법의 주요 특징과 대표 모델은 Table 4에 요약하였다. 또한 성능 평가는 주로 Precision, Recall, F1-score, IoU와 같은 지표를 통해 이루어지며, 각 지표의 정의는 Table 5에 정리하였다.

Table 4.

Classification and representative model of AI techniques used in UAV-based visual inspection

Table 5.

Performance evaluation metrics in AI-based visual inspection

이러한 연구 방법을 바탕으로, 다음 장에서는 선정된 7편의 논문을 대상으로 적용 구조물, 센서 구성, AI 기법, 탐지 대상 등을 기준으로 비교·분석하고, 그 결과를 종합하여 고위험 건설기계 분야로 확장 가능한 기술적 시사점을 도출한다.

UAV-AI 기반 자동 외관 검사 기술의 주요 사례 분석

본 장에서는 제2장에서 선별한 7편의 논문을 대상으로 UAV–AI 기반 자동 외관 검사 기술의 적용 사례를 분석한다. 분석 대상은 교량, 송전탑, 통신탑, 컨테이너 크레인 등 대형 구조물로, 이들은 건설기계와 마찬가지로 수동 점검이 어렵고 위험성이 높은 인프라에 해당한다. 각 사례는 UAV 플랫폼과 센서 구성, 데이터 획득 및 처리 과정, 적용된 AI 기법과 성능 평가지표, 연구 결과와 한계를 중심으로 정리하였다. 이를 통해 UAV–AI 기반 자동 외관 검사 기술의 활용 현황과 성과, 그리고 한계를 고찰한다. 본 장의 사례별 분석 결과는 제4장에서 수행할 종합 비교와, 향후 타워크레인·항타기 등 고위험 건설기계 분야로의 확장 가능성 논의를 위한 기초 자료로 활용된다.

강재 교량 부식 탐지 사례

Ameli et al.(2023)은 강재 교량의 부식 상태를 정밀하게 평가하기 위해 UAV 영상 수집과 딥러닝 기반 인스턴스 세그멘테이션을 결합한 자동 외관 검사 시스템을 제안하였다. 기존 연구가 바운딩 박스를 활용한 단순 탐지에 머물렀던 것과 달리, 본 연구는 AASHTO 및 BIRM 규정을 기반으로 부식 영역을 픽셀 단위로 분할하고 상태 등급(“Fair”, “Poor”, “Severe”)을 자동 산정하는 것을 목표로 하였다.

데이터는 미국 내 강교의 거더(girder)와 지지대를 대상으로 수집되었다. DJI Mini UAV와 NIKON D750 카메라를 활용해 총 514장의 고해상도 이미지를 확보하였으며, 촬영 시 구조물과의 거리를 1m 이상 유지하여 충돌 위험을 최소화하고 다양한 각도에서 영상을 수집하였다. 흐리거나 어두운 이미지는 제외하고, 구조 전문가가 LabelMe 툴을 사용해 부식 부위를 다각형 마스크로 라벨링하고 심각도에 따라 세 등급으로 분류하였다. 도장 박리나 단순 이물질은 부식으로 간주하지 않았다.

모델 학습에는 Mask R-CNN과 YOLOv8-Seg를 적용하였다. 입력 크기 640×640 픽셀 기준으로 데이터셋을 학습(80%)과 검증(20%)으로 분할하고, YOLOv8은 학습률 0.0001, 250 에폭, Mask R-CNN은 학습률 0.00025, 200 에폭으로 학습을 진행하였다. 성능 비교 결과(Fig. 2, Table 6), YOLOv8은 Precision에서 우수했고 Mask R-CNN은 Recall과 mAP50에서 강점을 보였다. F1-score는 각각 0.730(YOLOv8), 0.745(Mask R-CNN)으로 유사했으며, 처리 속도에서는 YOLOv8이 이미지당 0.03초로 Mask R-CNN(0.12초)보다 월등히 빨랐다.

Fig. 2.

Expert-annotated corrosion regions compared with the detection and segmentation results of YOLOv8 and Mask R-CNN (Ameli et al., 2023).

Table 6.

Performance comparison of YOLOv8 and Mask R-CNN in terms of F1-score, precision, recall, and mAP50 on validation and test datasets (Ameli et al., 2023)

| Trained Model | Dataset | F1-score | Precision | Recall | mAP50 |

| YOLOv8 | Validation | 0.451 | 0.602 | 0.360 | 0.484 |

| Test | 0.730 | 0.853 | 0.647 | 0.726 | |

| Mask R-CNN | Validation | 0.519 | 0.428 | 0.660 | 0.483 |

| Test | 0.745 | 0.625 | 0.922 | 0.674 |

시각화 결과, YOLOv8은 미세 부식을 정밀하게 분할하는 경우가 많았으나 일부 배경을 오인하거나 작은 부식을 누락하는 사례가 있었다. 반면 Mask R-CNN은 복잡한 경계와 다수의 부식 영역을 안정적으로 식별했지만, 불필요한 영역이 포함되는 경우가 많아 정밀도가 낮았다.

이 연구는 UAV와 AI를 결합하여 강철 교량의 부식 상태를 산업 표준에 맞춰 자동으로 평가할 수 있음을 입증하였다. 특히 픽셀 단위 세분화와 등급 산정은 기존 점검 방식의 한계를 보완하는 중요한 성과로 평가된다. 다만 클래스 불균형 문제와 다양한 조명·배경 조건에서의 일반화 성능은 여전히 개선 과제로 남았다. 연구진은 향후 데이터 보강과 다양한 환경에서의 학습을 통해 성능을 향상시킬 필요성을 제안하였다. 본 연구는 교량 분야에서 UAV–AI 기반 자동 외관 검사의 대표적 사례로 중요한 참고가 된다.

철제 송전탑 부식 탐지 사례

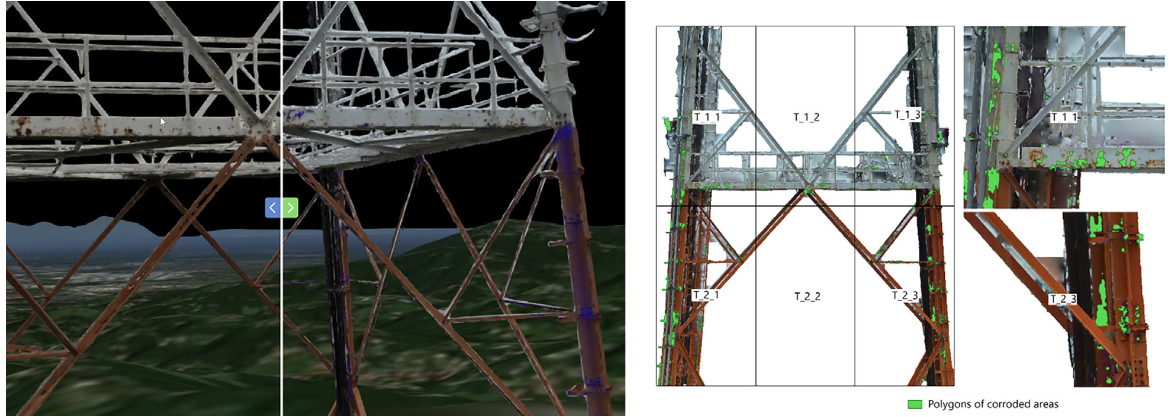

Savino et al.(2025)은 송전탑의 부식 상태를 정량적으로 평가하기 위해 UAV 기반 고해상도 이미지 수집과 딥러닝 시맨틱 세그멘테이션(semantic segmentation) 기법을 결합한 자동 외관 검사 프레임워크를 제안하였다. 기존 점검 방식은 직접 접근이 필요해 안전 위험이 크고 평가의 주관성 문제를 내포하고 있었다. 본 연구는 UAV와 AI 기술을 활용해 부식 면적을 자동 산출하고, 이를 유지관리 의사결정에 활용 가능한 정량적 데이터로 전환하는 것을 목표로 하였다.

연구는 이탈리아 토리노 Eremo 방송센터의 철제 송전탑을 대상으로 수행되었다. 상용 쿼드콥터 UAV(DJI Matrice 300 RTK)에 Zenmuse P1 풀프레임 카메라(45 MP)를 장착하여 다양한 고도와 촬영각에서 총 999장의 고해상도 이미지를 수집하였다. 촬영 조건에는 직사광선과 그늘 등 다양한 조도 환경이 포함되었다. 수집된 이미지는 전문가가 부식 부위를 다각형 단위로 정밀 라벨링하였으며, 데이터셋은 학습(80%)과 검증(20%)으로 분할되었다. 배경 비율이 높아 발생한 클래스 불균형 문제는 median frequency balancing 기법으로 보정하였다.

AI 모델은 DeepLabv3+를 기반으로 하였으며, ResNet-50, VGG-16/19, MobileNetV2, Xception, InceptionResNetV2 등 다양한 백본(backbone)을 비교 분석하였다. 정확도, IoU, 학습 시간 등을 종합적으로 고려한 결과, MobileNetV2 백본을 적용한 DeepLabv3+가 최적의 성능을 보였다. 최종 모델은 검증 정확도 90.8%를 달성하였으며, 세그멘테이션 결과는 Fig. 3과 Fig. 4에 제시된 바와 같이 3D 모델링과 연계되어 정량적 면적 산출 및 디지털 트윈 구축으로 확장되었다.

Fig. 3.

Expert-annotated corrosion regions and predicted results obtained from DeepLabv3+ (MobileNetV2 backbone) (Savino et al., 2025).

Fig. 4.

Conversion of segmented corrosion areas into quantitative surface measurements and integration into the 3D tower model (Savino et al., 2025).

이 연구는 UAV–AI 기반 외관 점검이 송전탑 유지관리의 객관성과 효율성을 동시에 확보할 수 있음을 입증하였다. 다만 브래킷, 볼트 등 복잡한 구조에서는 면적 산정 오차가 발생하였고, 부식 경계가 불분명한 부위에서는 탐지 성능이 저하되었다. 이에 대해 TIN 기반 직접 적분, 곡률 보정, 하이퍼스펙트럼 데이터 융합 등을 향후 개선 방향으로 제안하였다. 본 사례는 송전탑 부식 상태를 정량적으로 평가할 수 있는 UAV–AI 기반 기술의 가능성을 보여주는 대표적 연구로 의의가 크다.

철제 송전탑 외관 손상 탐지 사례

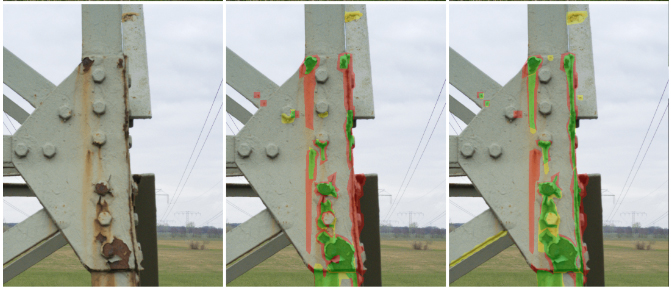

Barreiro et al.(2021)은 UAV 이미지를 활용하여 송전탑의 외관 손상을 자동으로 탐지하기 위한 인스턴스 세그멘테이션(instance segmentation) 기반 검사 시스템을 제안하였다. 기존 점검 방식은 비용과 위험 부담이 크며, UAV 영상이 널리 활용되고 있음에도 여전히 대규모 이미지의 수동 분석이 필요하다는 한계가 존재하였다. 본 연구는 데이터 부족, 클래스 불균형, 손상 경계 모호성 등 실제 현장의 문제를 해결하는 데 초점을 맞추었다.

이 연구에서는 송전탑을 대상으로 전문가가 UAV를 수동 비행하여 촬영한 고해상도 RGB 이미지를 활용하였다. 총 165장의 이미지가 수집되었으며, 이 중 20장은 무손상 참조 이미지였다. 손상 유형은 부식, 도장 결손, 외층 도장 박리로 정의되었고, 유지보수가 필요 없는 오염(dirt)도 별도 클래스에 포함되었다. 모든 이미지는 전문가가 다각형 단위로 라벨링하였다. 데이터 부족 문제 해결을 위해 다음 세 가지 핵심 기법이 적용되었다.

• 데이터 증강: Poisson Image Editing과 COCO 데이터셋을 활용한 자동 증강을 통해 손상 패치를 다양한 배경에 자연스럽게 삽입하였다.

• 슬라이딩 윈도우 분할: 원본 해상도를 유지하며 이미지를 겹치는 타일로 분할하여 작은 손상도 인식할 수 있게 하였다.

• 이중 클래스 학습: 손상과 오염을 구분하여 학습시켜 오탐률을 감소시켰다.

AI 모델은 CenterMask를 채택하였으며, 백본(backbone)으로 VoVNetV2, 탐지 헤드로 FCOS, 세그멘테이션 모듈로는 SAGM(Spatial Attention-Guided Mask)을 적용하였다. 이 조합은 다양한 크기와 형태의 손상 탐지에 강점을 보였다. Fig. 5에 제시된 결과는 제안 기법이 베이스라인 모델 대비 탐지 성능을 개선했음을 보여준다. Table 7은 제안된 각 기법이 IoU 성능 향상에 미친 영향을 비교한 수치로, Augmented + Image Split 조합이 가장 높은 성능을 기록하였다.

Fig. 5.

Prediction examples of corrosion detection: original image (left), baseline approach (middle), and augmented + image split approach (right) (Barreiro et al., 2021).

Table 7.

Comparison of IoU performance among baseline, augmentation, image split, and combined approaches (Barreiro et al., 2021)

| Baseline | Augmented | Image Split | Image Split + Augmented |

| 53.56% | 60.09% | 59.85% | 60.07% |

본 연구는 UAV–AI 기반 자동 외관 검사가 송전탑 손상 탐지에서 속도, 안전성, 정확성을 크게 향상시킬 수 있음을 입증하였다. 다만 촬영 시점과 조명 조건에 따른 가시성 저하, 라벨링 주관성에 따른 일부 미검출 사례는 여전히 한계로 남았다. 이에 따라 데이터셋 확장과 다양한 손상 유형에 대한 일반화 성능 확보가 향후 연구의 과제로 제시되었다. 본 사례는 송전탑 외관 손상 탐지의 실무적 문제 해결에 기여한 대표적 연구로 평가된다.

통신탑 부식 탐지 사례

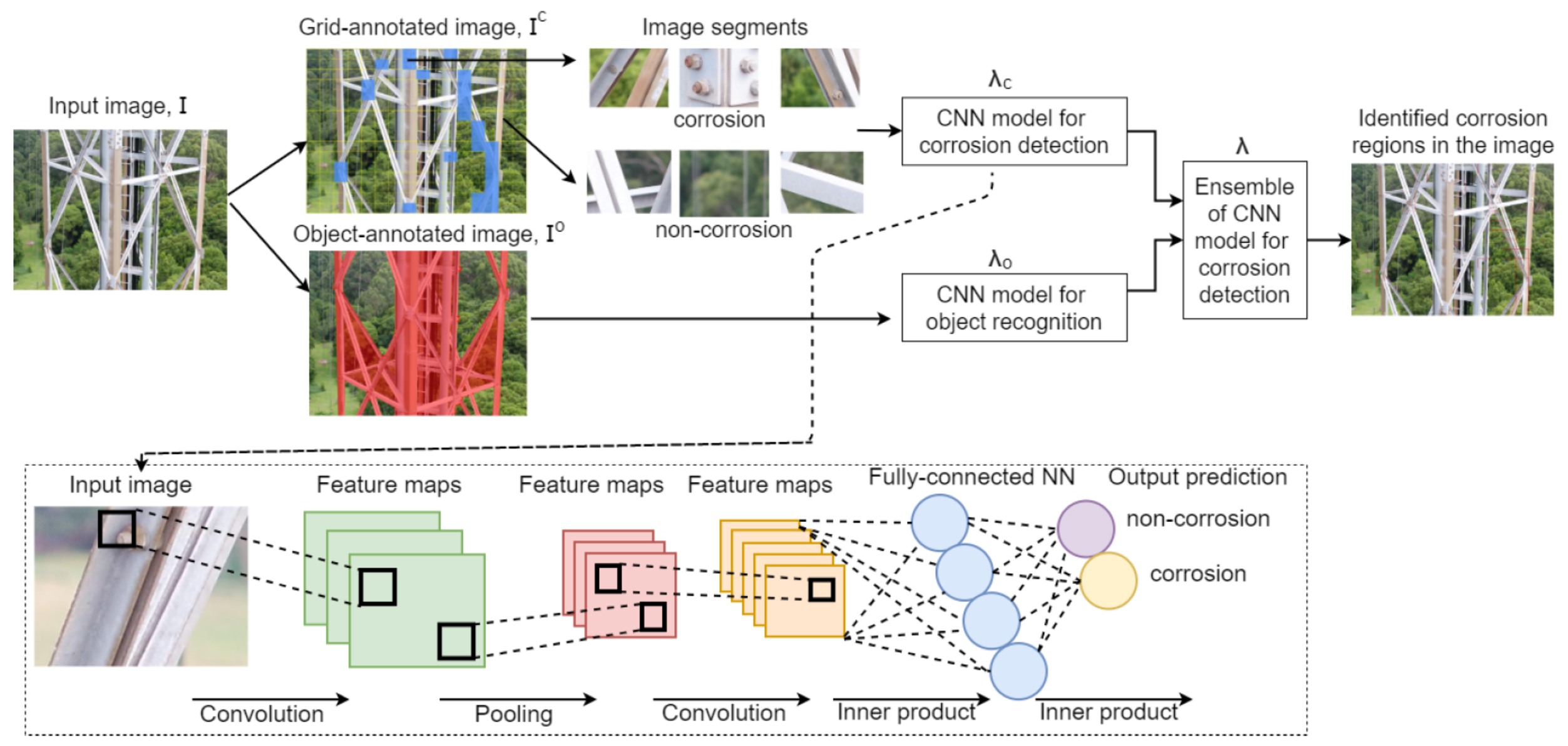

Forkan et al.(2022)은 UAV로 촬영한 고해상도 통신탑 이미지를 이용하여 산업 인프라의 부식을 정밀하게 탐지하는 앙상블 딥러닝 기반 프레임워크 CorrDetector를 제안하였다. 기존 연구들이 단일 딥러닝 모델에 기반해 부식 여부만을 판별한 반면, 본 연구는 세그먼트 단위 부식 검출 모델(λc)과 대상 구조물 식별 모델(λo)의 출력을 결합한 이중 모델 기반 앙상블 구조를 설계하여, 다양한 촬영 조건에서도 안정적인 탐지가 가능하도록 했다.

연구는 통신탑을 대상으로 수행되었으며, UAV를 활용해 다양한 각도와 거리에서 고해상도(RGB 5280×3952) 이미지 573장을 확보하였다. 각 이미지는 16×16 픽셀 단위로 분할되어 총 146,688개의 세그먼트로 구성되었으며, 전문가가 RatSnake 툴로 부식·비부식을 라벨링하고, LabelMe 툴을 이용해 통신탑의 부식 영역을 다각형 형태로 라벨링하였다.

CorrDetector의 전체 구조는 Fig. 6과 같다. 첫 번째 구성 요소인 λc는 VGG16 기반 shallow CNN으로 세그먼트 단위 부식을 탐지하고, 두 번째 구성 요소인 λo는 Mask R-CNN (ResNet-101 FPN 백본)으로 통신탑 구조를 인식한다. 이들의 출력은 각각 이진 출력 기반 특징(FB)과 신뢰도 기반 특징(FC)으로 변환되어, 최종적으로 MLP(Multi-Layer Perceptron), SVM(Support Vector Machine), XGBoost와 같은 머신러닝 분류기에 입력된다.

Fig. 6.

Overall pipeline of CorrDetector: shallow CNN for candidate detection, Mask R-CNN for corrosion region identification, and feature extraction with machine learning classifiers (Forkan et al., 2022).

성능 평가는 여러 사전학습 CNN 모델(ResNet-50, InceptionV3, MobileNet 등)과 비교 실험을 통해 이루어졌으며, 정확도(Accuracy), 정밀도(Precision), 재현율(Recall), F1-score, IoU 등 다양한 지표가 사용되었다. CorrDetector는 Accuracy 92.5%, F1-score 90.8%를 기록하여 기존 단일 모델 대비 모든 지표에서 우수한 성능을 보였다. 특히 λc 단독 모델이 보였던 높은 재현율 대비 낮은 정밀도 문제를 효과적으로 보완하며, 오탐률 감소와 환경 변화 대응력을 동시에 확보하였다.

본 연구는 UAV 기반 고해상도 영상과 앙상블 딥러닝 기법을 결합함으로써, 산업 인프라 부식 탐지의 정확도와 신뢰도를 동시에 향상시킬 수 있음을 실험적으로 입증하였다. 연구진은 향후 다양한 구조물과 조도·기상 조건에서도 CorrDetector의 성능을 검증하고자 하며, 산업 현장에 실제 적용 가능한 수준으로 확장하겠다는 방향을 제시하였다.

콘크리트 교량 손상 탐지 사례

Liang et al.(2023)은 콘크리트 교량의 다양한 손상 유형을 자동으로 탐지하기 위해 UAV 기반 저고도 원격탐사 영상과 딥러닝 객체 탐지(object detection) 모델을 결합한 다중 손상 검출 시스템을 제안하였다. 기존 수동 검사는 시간과 비용 측면에서 비효율적이며, 접근성 및 안전성에도 한계가 있었다. 또한, 기존 딥러닝 기반 탐지는 시맨틱 세그멘테이션을 통해 픽셀 단위의 손상 분할에는 유리하지만, 손상 위치와 유형을 동시에 정밀하게 탐지하고 분류하는 데는 어려움이 있었다. 이에 이 연구에서는 UAV 영상으로부터 균열, 박리, 철근 노출, 부식 등 다양한 손상을 동시에 식별하고 유형별로 분류함으로써, 교량 손상 탐지의 정확성과 효율성을 높이고자 하였다.

현장적용은 대구 북구에 위치한 경대교를 대상으로 수행되었으며, 고해상도 RGB 카메라를 탑재한 DJI Avata UAV를 이용해 교량 하부, 교각, 양측면을 포함한 저고도 원격탐사를 실시하였다. 비행 거리는 1~1.5m로 유지되었으며, 총 117장의 이미지가 수집되어 실제 현장 적용성과 성능 검증을 위한 테스트 데이터셋으로 활용되었다.

연구에 적용된 모델은 세 가지 구성 요소가 존재한다. 먼저 Swin Transformer 기반 백본을 통해 이미지 내 특징을 추출, LRGA-Net이 포함된 다중 스케일 주의 피라미드 네트워크를 통한 손상 객체 강조 및 글로벌 특징 학습, K-means를 이용한 앵커 박스를 사용하여 손상을 탐지 및 분류를 수행한다. 학습은 공개 데이터셋인 COncrete DEfect BRidge IMage Dataset(CODEBRIM)에서 30개의 교량에서 획득된 1,590장의 고해상도 이미지 중 훈련 세트(1,272장)를 사용하였다. 학습 과정에서는 이미지 증강 기법(Mosaic, Mixup 기법 등)을 통해 데이터 전처리와 증강을 진행하여 데이터 다양성을 확보하였다. Fig. 7은 실제 교량 이미지에서 탐지된 손상 부위를 시각화한 예시이다.

Fig. 7.

Example of detected damage regions on bridge images using the Swin Transformer + LRGA-Net model (Liang et al., 2023).

성능 평가는 mAP@0.5(mean Average Precision at IoU 0.5)와 F1-score를 기준으로 이루어졌다. 기존의 백본 및 객체 탐지 모델과 비교한 결과, 본 모델은 학습 수렴 속도와 탐지 정확도 모두에서 우수한 성능을 보였으며, 특히 손상 부위의 강조 효과가 뛰어났다. 최종적으로 mAP는 61.27%, F1-score는 37.8%를 기록하며 기존 접근법보다 향상된 시각적 결과를 도출하였다.

이 연구는 UAV와 Transformer 기반 딥러닝을 결합함으로써, 콘크리트 교량의 다중 손상을 효율적으로 탐지하고 분류하는 기술의 가능성을 입증하였다. 특히 다양한 크기와 형태의 손상을 동시에 탐지할 수 있다는 점에서 기존 기법 대비 실무 활용성이 높다. 다만, 학습 데이터와 실제 영상 간의 촬영 시점 차이나 위치 불일치로 인해 일부 오탐 및 누락이 발생하였으며, 저자들은 후속 연구에서 데이터셋 보강 및 촬영 시점의 다양화를 통해 성능을 향상시킬 필요성을 제안하였다.

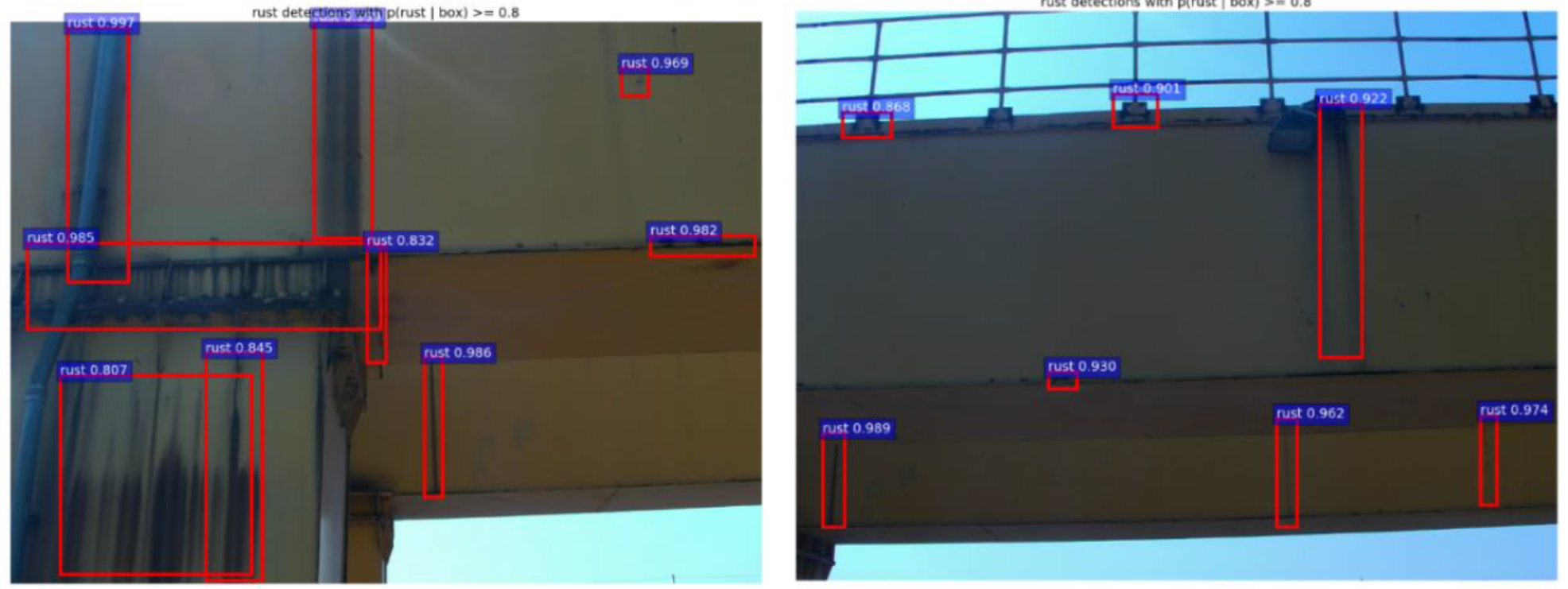

항만 크레인 실시간 손상 탐지 사례

Chen et al.(2019)은 항만 크레인의 정기적인 외관 점검을 자동화하기 위해, UAV 기반 영상 획득과 Faster R-CNN 딥러닝 모델을 결합한 손상 탐지 시스템을 제안하였다. 항만 크레인은 해풍으로 인한 부식, 반복되는 하중으로 인한 균열 등 다양한 외관 결함에 노출되며, 이는 장비의 기능 저하뿐 아니라 작업자의 안전에도 직결되기 때문에 정기적인 점검이 필수적이다. 그러나 기존의 수동 점검 방식은 고소 작업에 따른 안전 위험, 높은 비용, 시간 소요 등의 문제가 있으며, UAV 영상 기반 점검 또한 전문가의 사후 분석이 필요하다는 점에서 자동화의 한계가 존재했다. 이에 본 연구는 딥러닝 기반 손상 탐지를 통해 이러한 문제를 해결하고, 실시간 점검 체계 구축 가능성을 검토하였다.

연구 대상은 항만의 Frame Crane이며, 6축 멀티콥터 UAV에 HD CCD 카메라와 열화상(Infrared, IR) 카메라를 장착한 짐벌 시스템을 탑재하여 항공 영상을 수집하였다. UAV에는 온보드 머신비전 유닛이 탑재되어 촬영된 영상을 실시간으로 분석하고, 손상 의심 부위를 즉시 표출할 수 있도록 설계되었다. 지상 관제 시스템은 GPS, 배터리 상태, 비행 방향 등의 정보를 실시간으로 모니터링하며, 영상 수신과 초기 결함 식별을 지원하였다. UAV는 약 1시간 동안 비행하여 100장 이상의 영상을 확보하였고, 이 중 중복되거나 품질이 낮은 이미지를 제거한 후 최종적으로 63장의 이미지를 학습 데이터로 활용하였다. 라벨링은 LabelImg 도구를 사용하여 각 손상 부위에 바운딩 박스를 지정하는 방식으로 진행되었다.

적용된 AI 모델은 Faster R-CNN으로, 제안된 영역(region proposals)에 대해 경계 상자 회귀와 객체 분류를 동시에 수행하는 구조이다. 본 모델은 사전 학습된 가중치를 바탕으로 20,000 사이클 이상의 파인튜닝을 통해 손상 탐지에 최적화되었다. 정량적 평가는 수행되지 않았으나, Fig. 8에 나타난 탐지 예시를 통해 대부분의 부식 영역이 정확히 인식되었으며, 오탐과 누락이 거의 없었다.

Fig. 8.

Example of corrosion detection on a steel bridge using a UAV-based Faster R-CNN model (Chen et al., 2019).

이 연구는 UAV에 탑재된 머신비전 유닛과 딥러닝 탐지 모델의 결합을 통해, 대형 구조물의 손상을 실시간에 가깝게 탐지할 수 있는 가능성을 제시하였다. 이는 기존 수작업 기반 점검 방식에 비해 점검 효율성과 안전성 면에서 뚜렷한 이점을 제공한다. 다만, 소규모 데이터셋과 제한된 촬영 환경에서 학습이 이루어졌으며, 탐지 성능에 대한 정량적 평가지표가 제시되지 않았다는 점은 한계로 지적된다. 연구진은 향후 다양한 구조물과 촬영 조건에서의 데이터셋 확장, 정량적 성능 평가 도입, 거리 정보와의 결합을 통한 결함 크기 추정 등의 후속 연구가 필요하다고 제안하였다.

항만 크레인 구조 건전성 정밀 모니터링 사례

De Arriba López et al.(2024)은 강구조 컨테이너 크레인에 대해 UAV 기반 영상 촬영과 머신러닝을 결합한 비파괴 구조물 건전성 모니터링(SHM, Structural Health Monitoring) 파이프라인을 제안하고 실증하였다. 기존의 점검 방식은 숙련된 등반자가 육안으로 검사하는 방식으로 수행되어 왔으며, 이는 고비용·고위험·장시간 소요로 인해 정기적인 유지관리에 어려움이 있었다. 특히 크레인 내 주요 취약 부위(neuralgic area)는 접근이 어려워 점검 사각지대가 발생하기 쉬웠다. 또한, 기존의 자동화 시도는 그림자와 배경 색상 혼동, 강재 구조물에 의한 GNSS 신호 간섭, 촬영 각도 및 거리 변화 등으로 인해 결함 검출 정확도에 한계가 있었다. 본 연구는 이러한 문제를 해결하고자 녹, 피로균열, 재도장 흔적 등 조기 결함 징후를 정량적으로 검출·분류할 수 있는 영상 기반 자동 분석 시스템을 구축하는 것을 목표로 하였다.

연구는 독일 함부르크 HHLA-CTT 항만에 설치된 ZPMC 형식 컨테이너 크레인 14기 중, 전문가 협의를 통해 선정된 13개 주요 영역(neuralgic areas)을 대상으로 수행되었다. 영상 촬영은 DJI Zenmuse P1 카메라(Sony Alpha 7 IV 풀프레임 센서 기반)를 장착한 DJI 드론을 활용하였으며, 15m 또는 25m 거리에서 초점거리 25–85mm 조합으로 분기별 반복 촬영을 진행하였다. 구조물 특성상 GNSS 신호가 교란되므로, 경험 많은 UAV 조종사가 수동으로 웨이포인트를 설계하였다. 촬영된 이미지는 머신러닝 모델 학습을 위한 참값 데이터로 활용되기 위해 수동으로 주석 처리되었으며, 손상 유형은 전문가 자문을 바탕으로 Dirt(오염물, 비결함), Gland connection 변색, Repainting(재도장), Rust(부식), Crack suspicion(균열 의심)으로 정의되고 각 유형의 색상과 형태 특성이 명확히 설정되었다.

제안된 분석 파이프라인은 크게 두 단계로 구성된다. 첫 번째 단계는 영상에서 배경을 제거하고 대상 구조물만을 분리하는 것으로, Color Space Transformation(CST), Gaussian/Laplacian/DoG 기반 필터링, 텍스처 기반 분석 등이 활용되었으며, 이 중 U-Net을 적용한 전경 분리(Foreground Segmentation)가 가장 우수한 성능을 보였다. 두 번째 단계는 구조물 영역 내 손상 유형을 분류하는 과정으로, k-NN, Random Forest, Naive Bayes 등의 머신러닝 분류 알고리즘이 적용되었다. Fig. 9는 주요 손상 유형 및 검출 결과를 시각화한 예시이다. 실험 결과, U-Net 기반 전경 분리는 HSV 색상 변환 전처리 및 배치 크기 실험에서 배치 크기 16이 가장 안정적인 성능을 보였고, 테스트 세트에서 약 95%의 평균 정확도(Precision·Recall 기준)를 달성하였다. 손상 분류에서는 k-NN이 픽셀 기반 분류에서 F1-score 98%를 기록하며 최고 성능을 보였고, Random Forest는 세그먼트 기반 클래스 구분에서 강점을 보였다.

Fig. 9.

Representative examples of container crane damage types and defect detection results: (a) different damage types including dirt, rust, repainting, and crack suspicion; (b) step-by-step results of the segment-based method using Quickshift and Naive Bayes; (c) comparison of semantic segmentation results using Naive Bayes and kNN classifiers (De Arriba López et al., 2024).

이 연구는 드론 영상과 AI 기반 분석 기법을 결합하여 항만 크레인의 구조 건전성을 자동으로 정밀 모니터링할 수 있는 가능성을 제시하였다. 이는 기존 점검 방식의 한계를 극복하고 유지관리의 디지털 전환을 촉진하는 데 크게 기여할 수 있다. 다만, 그림자나 가림 현상, 배경 색상 혼동 등으로 인한 분류 정확도 저하, 다양한 구조물 및 재질에 대한 적용성 검증 부족 등은 한계로 지적된다. 연구진은 향후 콘크리트 및 복합재 구조물로의 확장 적용과 함께, 전이 학습, 강화 학습, 앙상블 기법을 통한 모델 신뢰도 향상을 제안하였다.

UAV-AI 기반 외관 검사 기술의 구성 요소, 한계 및 확장 가능성 분석

앞서 분석한 7편의 사례 논문은 모두 대형 인프라 구조물을 대상으로 UAV–AI 기반 자동 외관 검사 기술을 실증하였다. 본 장에서는 각 연구에서 적용된 UAV 플랫폼과 센서 구성, AI 기술의 특성과 차이를 종합적으로 분석하고, 공통적으로 드러난 한계와 함께 향후 고위험 건설기계 분야로의 확장 가능성을 논의한다.

UAV 플랫폼과 센서 구성의 비교

대부분의 연구는 대형 구조물의 복잡한 형상과 제한된 접근성을 고려하여, 기동성과 정밀 제어에 강점을 지닌 멀티콥터 형태의 회전익 UAV를 활용하였다. 특히 근접 촬영을 통해 세부 손상 정보를 확보해야 하는 특성상, 고정익 UAV보다 회전익 UAV가 주로 선택되었다.

센서 구성은 고해상도 RGB 카메라 중심으로 이루어졌으며, Chen et al.(2019)의 사례에서는 적외선(IR) 카메라, 초음파 센서, 레이저 거리 센서를 함께 장착하여 다중 센서 융합 기반 손상 탐지를 시도하였다. 이와 같이 플랫폼과 센서 구성의 차이는 대상 구조물의 특성과 탐지 목적에 따라 달라졌으며, 구체적 내용은 Table 8에 정리하였다.

Table 8.

Summary of UAV platforms and sensor configurations used in the seven representative studies analyzed

| Year and Author | Target Structure | Drone | Platform Type | Sensor Type |

| Ameli et al. (2023) | Steel Bridge | DJI Mini | Rotary-wing | Nikon D750 RGB Camera |

| Savino et al. (2025) | Transmission Tower | DJI Matrice 300 RTK | Rotary-wing | Zenmuse P1 Full-Frame RGB Camera |

| Barreiro et al. (2021) | Transmission Tower | N/A | N/A | RGB Camera |

| Forkan et al. (2022) | Communication Tower | N/A | N/A | RGB Camera |

| Liang et al. (2023) | Concrete Bridge | DJI Avata | Rotary-wing | RGB Camera |

| Chen et al. (2019) | Harbor Crane | Custom Hexacopter | Rotary-wing | HD CCD Camera + IR Camera + Ultrasonic/Range Sensor |

| De Arriba López et al. (2024) | Container Crane | DJI (model not specified) | Rotary-wing | Zenmuse P1 + Sony Alpha 7 IV Full-frame RGB Camera |

AI 기법의 선택과 기술적 특성

각 연구에서 적용된 AI 기법은 구조물의 종류와 탐지 대상 손상 유형에 따라 달리 선택되었다. 부식, 균열, 박리, 철근 노출 등 다양한 손상을 고려하여 Instance Segmentation, Semantic Segmentation, Object Detection, 앙상블 기반 분류 모델 등이 활용되었다.

일부 연구에서는 기존 CNN 기반 모델의 한계를 보완하기 위해 Transformer 기반 딥러닝 구조를 도입하거나, U-Net을 이용한 세그멘테이션 이후 머신러닝 분류기(K-NN, Naive Bayes, Random Forest 등)를 결합하는 방식으로 성능을 향상시켰다. Table 9는 이러한 AI 기법의 적용 현황과 모델 특성을 구조물 유형과 함께 종합적으로 비교한 것이다.

Table 9.

Summary of representative UAV–AI based inspection studies

| Year and Author | Target Structure | Damage Type | AI Technique | Model | Characteristics |

| Ameli et al. (2023) | Steel Bridge | Corrosion | Instance Segmentation | Mask R-CNN and YOLOv8 | Corrosion detection and damage area estimation |

| Savino et al. (2025) | Transmission Tower | Corrosion | Semantic Segmentation | DeepLabv3+ | Surface corrosion area detection |

| Barreiro et al. (2021) | Transmission Tower | Corrosion and Crack | Instance Segmentation | CenterMask | Automated damage detection and classification |

| Forkan et al. (2022) | Communication Tower | Corrosion |

Ensemble (Segmentation + Classification) | CorrDetector | Improved detection accuracy |

| Liang et al. (2023) | Concrete Bridge |

Crack and Spalling | Detection |

Transformer- based model | Overcoming CNN limitations |

| Chen et al. (2019) | Harbor Crane | Corrosion and Crack | Detection | Faster R-CNN | Real-time RGB + IR-based inspection |

| De Arriba López et al. (2024) | Container Crane | Corrosion and Crack |

Ensemble (Segmentation + Classification) | U-Net + Machine Learning | Automated structural health monitoring (SHM) evaluation |

UAV-AI 기반 외관 검사 기술의 공통적 한계

분석된 연구들에서는 몇 가지 기술적 한계가 공통적으로 확인되었다. 우선, AI 모델의 학습 성능과 일반화 능력은 데이터셋의 규모와 다양성에 크게 의존하나, 대부분의 연구는 RGB 기반의 소규모 데이터셋에 한정되어 있었다. 이로 인해 다양한 기후 조건, 조명 환경, 촬영 각도에서 안정적인 성능을 확보하기 어려웠다. 또한 손상 유형과 크기가 제한된 범위에 집중되어 모델의 보편적 적용에 제약이 있었다.

데이터 라벨링 과정에서도 문제점이 존재하였다. 전문가가 직접 손상 부위를 정의하고 라벨링하는 방식이 주로 사용되었으나, 이 과정은 시간 소모가 크고 기준의 일관성이 떨어질 수 있었다. 더불어 데이터셋 내 손상 유형 간 불균형은 특정 손상 탐지 성능 저하로 이어지기도 하였다.

이를 극복하기 위해 일부 연구에서는 다양한 센서를 융합하거나 데이터 합성 기법을 활용하여 가상의 훈련 데이터를 생성함으로써 데이터의 양과 다양성을 확보하고자 하였다. 또한 실시간 현장 적용을 고려하여 모델 경량화, 전이학습, 앙상블 기법 등을 통해 탐지 정확도를 향상시키는 시도가 이루어졌다.

고위험 건설기계로의 기술 확장 가능성

UAV–AI 기반 외관 검사 기술은 고정형 인프라 구조물에만 국한되지 않고, 이동형 고위험 건설기계로의 확장 가능성도 충분하다. 타워크레인, 항타기와 같은 건설기계는 구조가 복잡하고 실외 환경에서 지속적으로 운영되기 때문에, 고도 변화, 진동, 조도 및 기상 조건 변화 등 다양한 변수에 대응 가능한 데이터셋과 높은 일반화 성능을 지닌 모델이 요구된다.

특히 건설기계는 균열, 변형, 피로, 부식 등 복합 손상이 동시에 발생할 수 있어, 단일 결함 탐지에 국한되지 않는 다차원적 분석 체계가 필요하다. 이러한 특성은 교량이나 항공기 점검과 유사하게 고해상도 영상과 정밀 분석 기법을 요구하며, RGB 카메라에 열화상(IR) 센서, 초음파·레이저 거리 센서 등을 조합한 다중 센서 융합 진단 체계가 중요한 대안이 될 수 있다. 나아가 단일 시점의 검사 결과를 넘어 반복 촬영 기반 시계열 분석을 적용함으로써 손상의 진행 속도와 누적 정도를 평가하는 것이 안전 관리 측면에서 핵심적이다.

또한 건설기계 점검은 작업자의 안전과 직결되므로 탐지 결과의 실시간성 확보가 필수적이다. 이를 위해 경량화된 모델과 엣지 컴퓨팅을 기반으로 현장에서 즉시 탐지와 분석을 수행해야 하며, 나아가 시계열 기반 연속적 이상 탐지 시스템 구축이 요구된다. 더불어 탐지 결과를 시각화하고 보고서를 자동으로 생성하는 자동 리포팅 체계는 현장 활용도를 크게 높일 수 있다.

데이터 확보의 어려움 또한 중요한 과제이다. 실제 손상 데이터셋은 제한적이기 때문에, 합성 데이터 생성, 증강 기법, 시뮬레이션 기반 가상 데이터셋 구축 등을 통해 데이터 부족 문제를 보완해야 한다. 이를 통해 다양한 기후·조도 조건, 촬영 각도에서 발생하는 성능 저하 문제를 완화하고, 모델의 일반화 능력을 높일 수 있다.

실제 사례에서도 이러한 확장 가능성이 확인된다. Jiao et al.(2024)은 RTK 기반 위치결정과 UAV 영상을 활용하여 타워크레인 점검을 수행함으로써 안전성을 높였으나, 여전히 육안 검사에 의존하여 효율성과 정밀성에서 한계가 있었다. 반면 Zhou et al.(2024)은 YOLO 기반 다중 결함 탐지 시스템을 구축하여 결함 인식·정량화 및 자동 보고서 생성을 통해 UAV–AI 기반 자동화의 가능성을 입증하였다. 그러나 이들 연구는 단일 영상과 제한된 환경에서만 검증된 사례로, 범용성과 실시간 적용 측면에서는 보완이 필요하다. 이처럼

따라서 고위험 건설기계 점검에서는 다중 센서 융합, 시계열 기반 분석, 합성 데이터셋 구축, 모델 경량화, 자동 리포팅 체계가 핵심 전략으로 요구된다. 이를 통해 UAV–AI 기반 손상 자동 점검 기술은 대형 인프라 구조물의 유지관리 효율성과 안전성을 높일 뿐 아니라, 고위험 건설기계 분야에서도 스마트 안전 관리 및 예지 정비 체계로 확장·발전할 수 있는 잠재력을 지니고 있다. 특히 고위험 건설기계는 녹, 균열, 휨과 같은 구조적 손상뿐만 아니라 볼트, 핀 등의 부재 결함이나, 실린더 누유 등 외부에서 직접 확인하기 어려운 영역에서 다양한 결함이 발생할 수 있어, UAV–AI 기반 자동화 점검의 필요성이 더욱 크다.

결 론

본 연구는 무인항공기(UAV)와 인공지능(AI)을 기반으로 한 자동 외관 점검 기술의 주요 사례를 체계적으로 분석하고, 이를 고위험 건설기계 분야로 확장 적용할 수 있는 가능성을 고찰하였다. 특히 교량, 송전탑, 통신탑, 항만 크레인 등 다양한 인프라 구조물에 적용된 UAV–AI 기반 점검 기술을 검토함으로써, 플랫폼 유형, 센서 구성, AI 기법, 탐지 성능 등 핵심 기술 요소와 구현 특성을 종합적으로 비교하였다.

분석 결과, 대부분의 연구는 회전익 UAV와 고해상도 RGB 카메라 기반 데이터 수집을 바탕으로 Detection, Segmentation, Classification 등의 AI 기법을 활용하였으며, 실시간성·정량성·자동화를 통해 기존 육안 점검 방식의 한계를 극복하고자 하였다. 또한 일부 연구에서는 Transformer 기반 딥러닝, 머신러닝 앙상블, U-Net 기반 세그멘테이션 등 다양한 시도를 통해 정확성과 안정성을 동시에 확보하였다.

그러나 학습 데이터의 편향, 촬영 환경의 다양성 부족, 전문가 의존적 라벨링의 한계 등은 공통적으로 나타난 기술적 제약이었다. 이러한 문제는 고위험 건설기계와 같이 실외 고도작업 환경에서 운용되는 장비에 적용될 경우 더욱 심각하게 작용할 수 있다. 실제로 타워크레인, 항타기 등의 경우 구조가 복잡하고 작업자가 접근하기 어려우며, 실시간 분석과 안전 확보가 필수적이기 때문에 데이터 다양성 확보, AI 모델의 일반화 성능, 그리고 경량화된 실시간 처리 기술이 무엇보다 중요하다.

따라서 본 연구는 UAV–AI 기반 자동 점검 기술의 단순한 정리에 그치지 않고, 고위험 건설기계 적용을 위한 기술적·현장적 고려사항을 제시하고 향후 연구 방향을 다음과 같이 제안하였다.

• 건설기계 대상 실제 현장 데이터셋 구축 및 공개: 타워크레인, 항타기 등 실제 현장에서 촬영된 다양한 조건의 고해상도 영상 데이터셋을 구축하고, AI 모델 학습을 위한 공공 데이터로 제공할 필요가 있다.

• 환경 변화에 강건한 경량화 AI 모델 개발: 조도, 기상, 촬영 각도 등 다양한 외부 변수에 대응 가능한 AI 모델 설계가 필요하며, 실시간 점검을 위한 경량화 및 임베디드 시스템 최적화가 요구된다.

• 3차원 모델링 및 디지털 트윈 연계 기술 개발: UAV–AI 기반 점검 데이터를 3D 구조 모델과 연계하여, 결함의 위치·크기·위험도를 실시간으로 시각화할 수 있는 디지털 트윈 기반 유지관리 시스템 개발이 필요하다.

이러한 연구 방향은 스마트 건설 안전관리 체계 구축, 유지보수의 디지털 전환, 작업자 위험 최소화 등에서 높은 산업적·사회적 파급효과를 기대할 수 있으며, UAV–AI 기술의 실질적 확산과 상용화를 위한 전략적 기반이 될 것이다.